「生成AIイヤー」とも言える2023年も終わりに近づいてきたが、ここにきてグーグルがさらに新しい技術を投入すると発表した。

グーグルは12月7日(日本時間)、生成AI向けの新しい大規模言語モデル「Gemini(ジェミニ)」を発表した。

自社のチャットAI「Bard」はもちろん、「Pixel 8 Pro」をはじめとしたAndroidスマートフォンへの組み込みも進める。

グーグルのスンダー・ピチャイCEOはリリースの中で、Geminiをこう表現する。

「賢いソフトウェアというよりも、より便利で直感的な、相談できる専門家または仲間のように感じられるようになる」

グーグルが本気で取り組んだGeminiとは、どんな存在なのだろうか。

「絵」「音」「手書き」なども把握して「論理的に回答」

以下は、グーグルが公開したGeminiのデモだ。全編が英語だが、その内容は非常に興味深い。

絵を描くと、その内容を認識して「アヒルですかね」と話し、さらに「普通のアヒルは青ではないですよ」と指摘までする。

手の動きから「じゃんけんをしようとしている」と指摘し、手品で騙されたことも理解する。

クッキーとオレンジが並ぶと、「どちらも丸い食べ物ですが、オレンジの方が健康的ですね」と答え、2色の毛糸玉から作れるマスコットも提案する。

絵から太陽系の惑星の並びの間違いを指摘し、動画の「次のシーン」の予測までこなす。

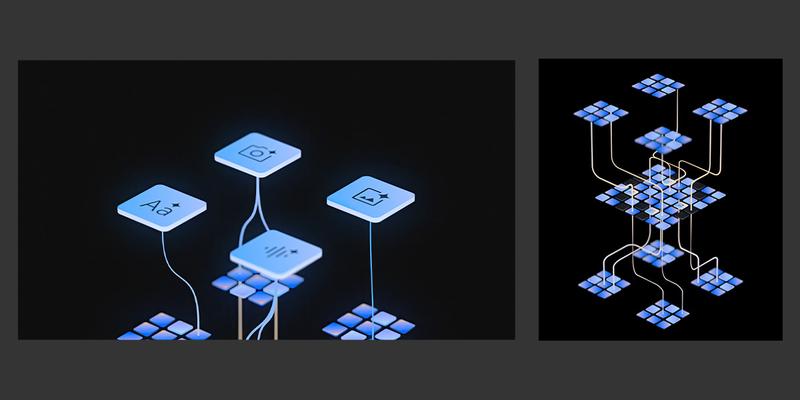

これらのように、文章から回答を作るのではなく、声や画像、立体物に動画と、さまざまな情報を並列に扱って、それぞれをちゃんと理解し、論理的な回答をする。

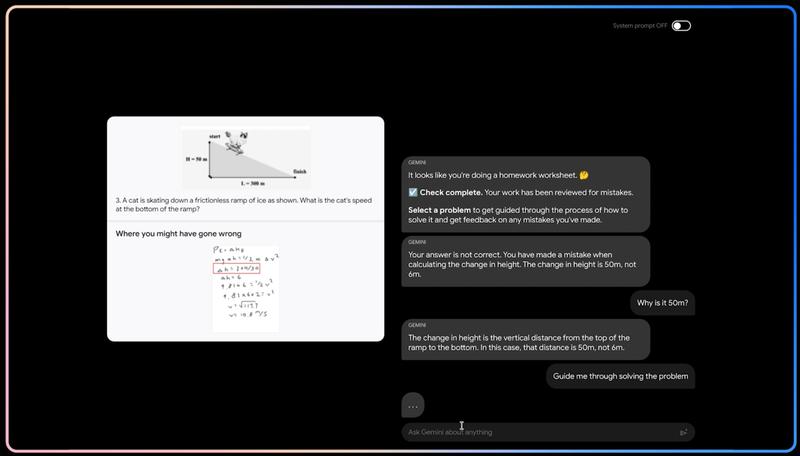

別の例も示してみよう。

物理のテストの回答があったとする。従来なら、まず手書き認識をして、その内容が正しいかをさらに判定するだろう。

だが、Geminiでは処理を分けることもなく、Geminiが持つ能力自体で「文字認識」「回答の妥当性検証」を行い、正誤判定を出す。さらに、正しい回答を示すことも可能だ。

これが、Geminiの特徴だ。このように、複数の情報を同時に扱える要素のことを「マルチモーダル性」という。

従来は「テキスト」「画像」「音声」などをバラバラに学習して組み合わせていたが、Geminiは学習の段階からマルチモーダル性を前提に、まったくのゼロから学習し直して開発されている。

そのため、前述のような複雑な理解と回答ができるようになっているのだ。

デモ映像を見る限り、確かに「驚くべき性能」という他ない。

もちろん、最も大きいのは「信頼性」だ。グーグルは信頼性の担保に相当の時間を費やしたと見られるが、実際の「賢さ」は、やはりちゃんと試してみるまでわからない。

だが、ここまでのものを(映像とはいえ)見せられると、期待したくなってくる。

グーグルの新基盤として全社一丸となって開発

グーグルは2023年5月、開発者会議「Google I/O 2023」にて、独自の生成AI「PaLM 2」の提供を開始した。

現在PaLM 2は、チャットサービスである「Bard」や同社のオフィス向けツールであるGoogle Workspace向けの支援AI「Duet AI」、検索サービスへの試験導入である「SGE」などにも使われる、同社の基盤技術となっている。

一方、Google I/Oの段階で、すでに同社は「PaLM 2の上位セットとなる生成AI」の開発プロジェクトを公開していた。

その名が「Gemini」だった。当時は詳細が明かされず、まだまだ先の登場と思われていただが、結局年内に登場となった。

開発はまさにグーグル総がかりだ。

開発を担当したのは、グーグルのリサーチ部門に加え、グーグル子会社で囲碁プログラム「AlphaGo」を開発したことでも知られるDeepMindと、グーグル社内の機械学習チームだったBrain Teamが合流した部隊だ。

演算のインフラとしては、グーグルが独自開発したデータセンター向け半導体「Cloud TPU」の最新バージョンとなる「Cloud TPU v5p」が投入された。これはAIのトレーニングに特化した「Cloud TPU v4」と比較した場合、大規模言語モデルの学習速度が2.8倍高速であるという。

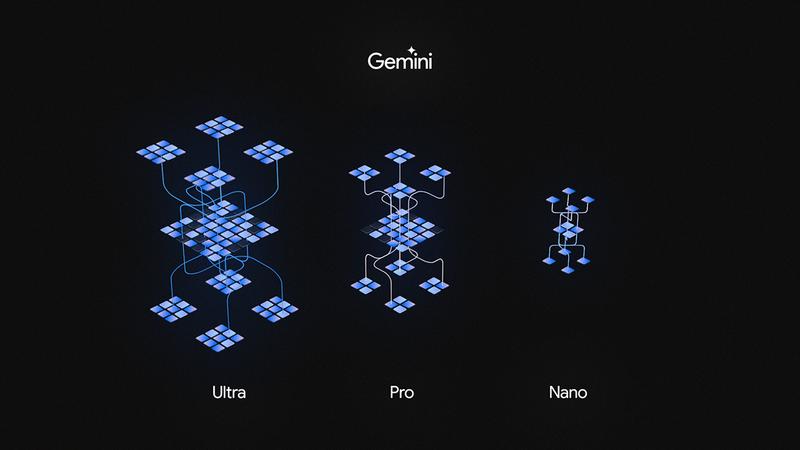

「Ultra」「Pro」「Nano」の3モデル展開

Geminiには規模が違う3つのモデルが用意され、用途に応じて使い分けられる。それぞれについて、いわゆるパラメータサイズなどの詳細は公開されていない。

まずは最も規模が大きく、機能も推論能力も最も高く、複雑な処理をこなせる「Gemini Ultra」。冒頭のテストはUltraのものと推察される。

グーグルによると、生成AIのモデルを評価するために使われているベンチマーク32種類のうち「30で既存の最高水準の結果を上回っている」(リリースより抜粋)という。

また、MMLU(Massive Multi-task Language Understanding、大規模マルチタスク言語理解)と呼ばれる、「数学」「物理学」「歴史」「法律」「医学」「倫理」など57科目の組み合わせで知識や問題解決能力を測るテストでは「90.00%」のスコアを出し、「人間の専門家を上回るパフォーマンスを示した初のモデル」(同リリースより)としている。

ただし、こちらはまず限定的なメンバーによるテストを開始する段階。2024年初めには、ファインチューンおよび人間からのフィードバックを活かし改善した形で公開を予定している。

またBardについては、2024年にGemini Ultraが公開されるタイミングで、より最先端の機能を組み込んだ「Bard Advanced」を提供するという。

より一般的なモデルが「Gemini Pro」だ。こちらはすぐにも提供が開始される。

まずBardにテキストベースの生成AIとして、まずは170以上の国と地域で「英語による利用」がスタートする。数カ月以内にマルチモーダル機能をサポートする予定だ。すなわち、BardのベースはGemini Proになり、上位版としてBard Advancedが登場する……ということのようだ。

Gemini Proは当面同社の基盤AIになると見られており、検索サービスや広告、Chrome、Duet AIなどにも、数カ月の時間をかけて展開していくという。

また、12月13日からは、開発者向けにGemini Proを活用するためのAPIを公開する。

スマホの中にもGemini。まずはPixel 8 Proから

そして、最後が「Gemini Nano」だ。

これはスマートフォンの中で動かすことを前提とした「オンデバイスAI」であり、クラウドの向こうに依存することなく、機器の中で素早く動作させることを狙う。

そのためグーグルは、Android 14から「AI Core」という仕組みを導入している。ここに各ハードウェアに合わせたオンデバイスAIを組み込むことで、生成AIのパワーをスマホ単体で活用しやすくしていく。

Gemini NanoはこのAI Coreを使ってスマホに組み込まれる。まず導入されるのは、グーグルのスマホである「Pixel 8 Pro」だ。

Pixel 8 Proには端末上で録音音声を文字に書き起こす機能がある。今回さらに、書き起こした文章を要約する機能がつく。

また、「WhatsApp」などのメッセージングアプリには、生成AIによる「スマートリプライ」機能も搭載になる(ただし、スマートリプライの日本語での提供時期は未定)。

まずPixel 8 Proから提供される理由は、Gemini Nanoがグーグルの設計するプロセッサーである「Tensor G3」に特化して作られているからだ。

ただし、まずは「メモリー容量の問題もあり」(グーグル担当者)、搭載メモリーが少ない「Pixel 8」は除外した形で展開する。

ただし、グーグルとしては「Gemini Nanoの最適化をG3以外にも広げていく」としており、他のTensorシリーズや、クアルコムなどの他社プロセッサーの「AI Core」への対応も考えられる。